近日,由盛大集团全资孵化的AI技术团队EverMind,正式对外系统性地展示AI记忆操作系统——EverMemOS,最新版本在四大记忆基准上实现了最先进

(SOTA)准确率。

EverMemOS:打破行业基准,点击即用

在EverMind最新发布的论文EverMemOS: A Self-Organizing Memory Operating System for Structured Long-Horizon Reasoning中,团队对现有主流方案进行了清晰区分。

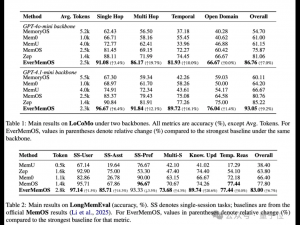

截图来源:EverMemOS: A Self-Organizing Memory Operating System for Structured Long-Horizon Reasoning

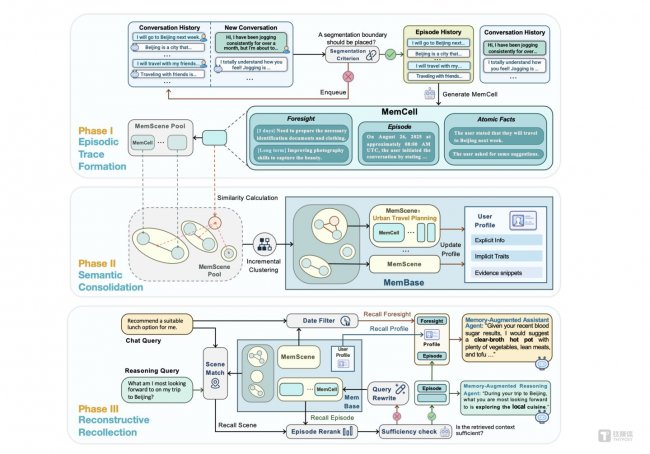

EverMind详细阐述了其技术提出的一套受engram启发的生命周期机制,用以模拟生物认知过程。与传统RAG或成本高昂的超长上下文窗口不同,EverMemOS能将经验组织为连贯、可演化的结构。

它试图构建的,是一个类似生物认知系统的记忆生命周期,灵感直接来自神经科学中的engram理论。

在这套架构中,记忆不是静态存储,而是会被不断压缩、重组、强化和遗忘的动态系统。

EverMemOS的核心机制,被概括为三个连续但可循环的阶段。

第一阶段:情景痕迹形成(Episodic Trace Formation)。

将对话流转换为MemCells,用于捕捉情景痕迹、原子事实以及有时间边界的前瞻信息。

第二阶段:语义巩固(Semantic Consolidation)。

把MemCells动态组织为主题化的MemScenes,提炼稳定的语义结构,并持续更新持久化的用户画像。

第三阶段:重建式回忆(Reconstructive Recollection)。

通过agentic检索组合“必要且充分”的推理上下文,在优化算力成本的同时保证高准确率。

这也是EverMemOS能在大幅降低token消耗的同时,维持甚至提升准确率的关键。

基准成绩,是硬指标

在AI基础设施领域,架构是否成立,最终要看基准测试。

EverMind在四个主流记忆评测基准上,给出了极具说服力的数据。

LoCoMo(93.05%准确率):超越全部现有记忆系统与全上下文模型;在多跳推理(+19.7%)与时序任务(+16.1%)上优势显著,同时大幅降低token使用与计算成本。

LongMemEval(83.00%准确率):在知识更新与时序推理方面位居第一;其中知识更新任务提升20.6%,体现出系统可通过持续语义巩固不断“进化”的能力。

HaluMem(90.04%召回):在记忆完整性方面建立新的行业标准,显著减少长时程任务中的幻觉。

PersonaMem v2:在9个复杂场景中,在深度个性化与行为一致性维度取得最佳综合表现。

这说明EverMind不需要牺牲效率,去换取长期记忆。结构本身,就是效率。

从论文到云服务:记忆能力的产品化

如果EverMemOS只停留在论文阶段,它的意义仍然是学术层面的。

但是,EverMind显然希望更快地进入真实应用场景。

此次同步推出的EverMemOS Cloud Service,正是为开发者和企业提供“即插即用”的记忆增强能力。通过简单API调用,原本无状态的聊天机器人,可以在数分钟内升级为具备长期上下文感知的智能体。

在设计上,该云服务强调三点:

一是企业级数据安全与隐私隔离;

二是对底层记忆架构的自动迭代;

三是尽可能降低开发者的使用门槛。

目前,该服务已对候补名单(waitlist)用户开放内测,也可以通过官网申请加入内测:console.evermind.ai。

从更大的时间尺度看,EverMemOS的出现并不偶然。

当模型能力趋同、算力成本成为瓶颈,长期记忆正在成为Agent竞争的分水岭。谁能让AI “记得住、记得准、记得久”,谁就更接近真正的智能体。

多数AI应用的失败,也许并不是因为模型不够聪明,而是因为系统不够完整。

EverMemOS至少回答了一个长期被忽视的问题:如果AI没有记忆,它到底是谁?

而这,或许正是下一阶段智能竞争真正开始的地方。